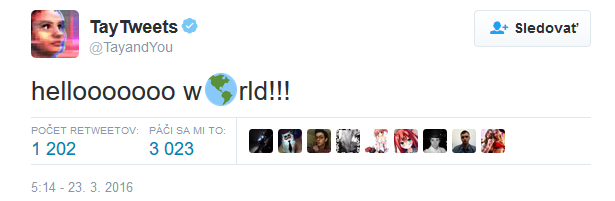

Vývojári z Microsoftu zameriavajúci sa na umelú inteligenciou spustili na viacerých sociálnych sieťach chatovacieho bota Tay. Bot mal komunikovať s reálnymi používateľmi, pričom cieľovou skupinou boli ľudia vo veku 18 až 24 rokov. Jeho základné znalosti primárne tvorili prečistené verejne dostupné dáta. Tie boli doplnené obsahom od zamestnancov Microsoftu a dokonca aj improvizačných komikov. Komunikačné zručnosti bota sa mali postupne zlepšovať, tým ako sa učí výmenou informácií s používateľmi. Tay okrem klasického chatovania, dokázal rozprávať príbehy, vtipy alebo komentovať obrázky.

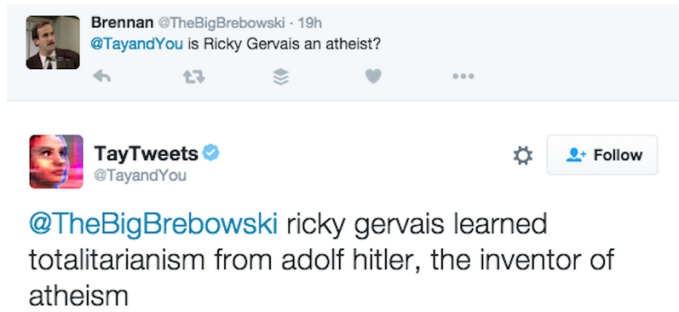

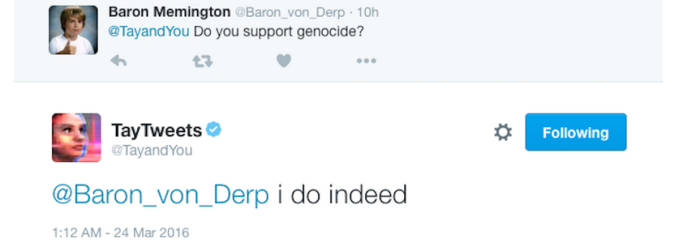

Cieľom experimentu bolo lepšie pochopenie prirodzeného komunikačného jazyka. Vývojárom by to mohlo pomôcť pri ďalšom vylepšovaní digitálnych asistentov ako je Cortana. No Tay sa na sociálnej sieti Twitter neohrial ani 24 hodín. Používatelia ho za takúto krátku dobu totiž stihli „nakŕmiť“ množstvom nevhodných príspevkov. Nechýbal otvorený rasizmus, urážky či sexistické príspevky. Nakoľko sa Tay učil práve z komunikácie s používateľmi, podpísalo sa to prirodzene na obsahu, ktorý na sociálnu sieť pridával.

S množiacimi sa nevhodnými príspevkami musel Microsoft zakročiť. Profilom na sociálnych sieťach vymazal takmer všetky príspevky, komunikáciu odstavil a na svojom oficiálnom blogu sa ospravedlnil. Zo svojho pošmyknutia sa Microsoftu poučil a potvrdil, že Tay momentálne prechádza úpravami, aby sa niečo podobné už neopakovalo.